让AI辅助还是全托管?5个章节帮你掌握背后的设计逻辑

编者按:我们一方面惊叹 AI 的强大,另一方面又会在任务托管给 AI 之后总觉得有点慌。我们在两个极端之间来回横跳,最近尤为频繁。那么在真实的项目当中,什么时候应该信任 AI ,什么时候应该依靠人的判断呢?这当中有没有一个明确的界限,或者说评价系统帮助我们更好的判断?当然是有的。Taras Bakusevych 的这篇文章就是你想要的答案。

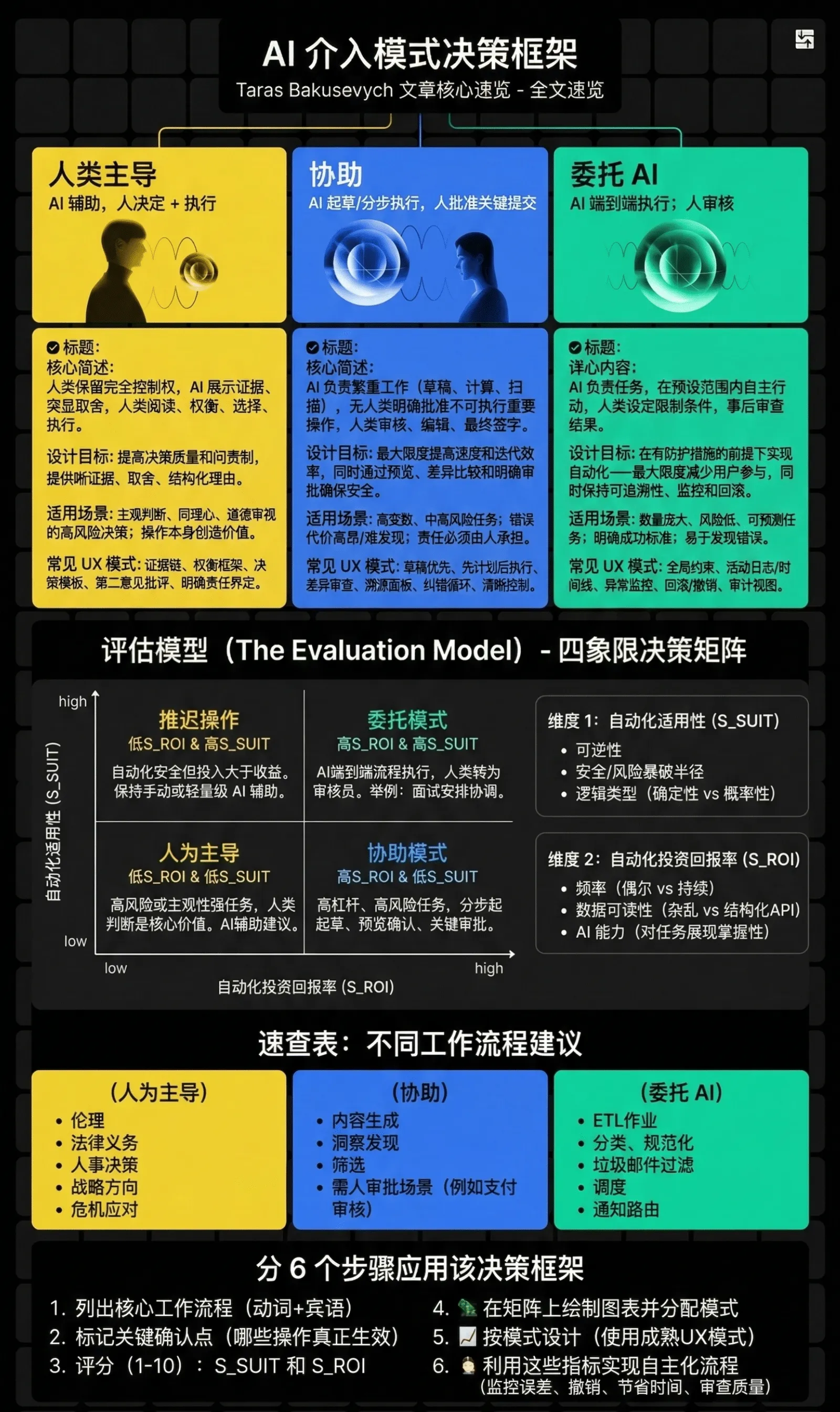

全文速览

多年来,APP 设计遵循着一个简单的方向:减少用户交互过程中的摩擦,让用户更快地完成任务。我们绘制流程图、简化步骤、优化交互——始终假设用户是主要参与者。

但是 AI 的存在,改变了这种假设。

如今,我们正处于一个危险的「混乱中间地带」。我们正在开发能够自主行动、决策和综合管理的软件,但我们仍然像设计一个简单的工具那样设计它。如果我们想打造真正深受用户喜爱的产品,就必须停止将 AI 「随意」添加到我们的工作流程中。我们必须回答一个根本问题:

此刻谁掌握着方向盘?其背后的逻辑是什么?

我们需要一种系统性的方法来超越「处处都有辅助驾驶」的 AI 介入模式。我们需要知道何时应该放手让机器完全接管方向盘,以及何时应该保护人类作为负责任驾驶员的角色。

本文提供了一个实用的框架,将「谁做什么」的决定转化为一个可重复的过程。

一、三种控制模式

事实上,用户的每个任务都对应三种交互模式中的一个。每种模式都定义了谁来执行操作、谁来做决定以及界面必须强制执行的内容。

1)人类主导

人类保留完全控制权。 AI 的作用是展示证据、突出权衡取舍并构建决策框架——但绝不替人类行动。人类负责阅读、权衡、选择和执行。

设计目标:通过向人类提供清晰的证据、权衡取舍和结构化的理由支持,提高决策质量和问责制。

适用场景:需要主观判断、同理心和道德仔细甄别的高风险决策,或者操作过程本身就能创造价值的情况。

常见的用户体验模式

- 证据链(相关事实、来源、先前案例、政策)

- 权衡框架(利弊、风险、替代方案)

- 结构化决策模板(相关标准+理由记录)

- 「第二意见」的批评(反驳论点、失效模式)

- 明确的责任界定(什么是建议,什么是决定)

2)协助

AI 负责繁重的工作——生成草稿、运行计算、扫描文档——但没有人类的明确批准,它无法执行任何重要操作。人类负责审核、编辑和最终签字确认。

设计目标:在关键点通过预览、差异比较和明确的人工审批来确保安全交付,同时最大限度地提高速度和迭代效率。

适用场景:高变数、中高风险的任务,此类任务中的错误代价高昂或难以发现,且责任必须由人承担。

常见的用户体验模式

- 草稿优先流程(生成→编辑→批准)

- 先计划后执行(「我将这样做」)

- 基于差异的审查(显示更改,而不仅仅是最终输出)

- 溯源面板(输入、来源、使用的约束条件)

- 具有不确定性情形和需要「为什么」解释的情况(系统何时/为何不确定)

- 持续的纠错循环(编辑某个一个部分,在本地重新生成)

- 清晰的控制(范畴明确的批准/应用操作)

3)委托 AI

通常是 AI 负责这项任务。它在预设的范围内自主行动。人类不批准具体的行动——人类会预先设定限制条件,事后审查结果。

设计目标:在有防护措施的前提下实现自动驾驶——最大限度地减少用户参与,同时保持可追溯性、监控和在需要时回滚。

适用场景:数量庞大、风险低、可预测的任务,具有明确的成功标准和易于发现的错误——人工审核会增加摩擦而不增加价值(例如,数据录入、垃圾邮件过滤、会议安排)。

常见的用户体验模式

- 全局约束(允许列表、预算、范围、时间窗口)

- 活动日志/时间线(发生了什么、何时发生以及依据哪项政策)

- 按异常情况监控(仅对异常情况发出警报)

- 在可行的情况下回滚/撤销操作(或采取补偿措施)

- 审计视图(抽样、质量保证工作流程、政策合规性)

二、评估模型

仅仅了解这三种模式是不够的。你需要一套系统的方法来判断哪种模式适合哪项任务。这些变量决定了机器是否应该运行,以及为此进行投资是否值得。

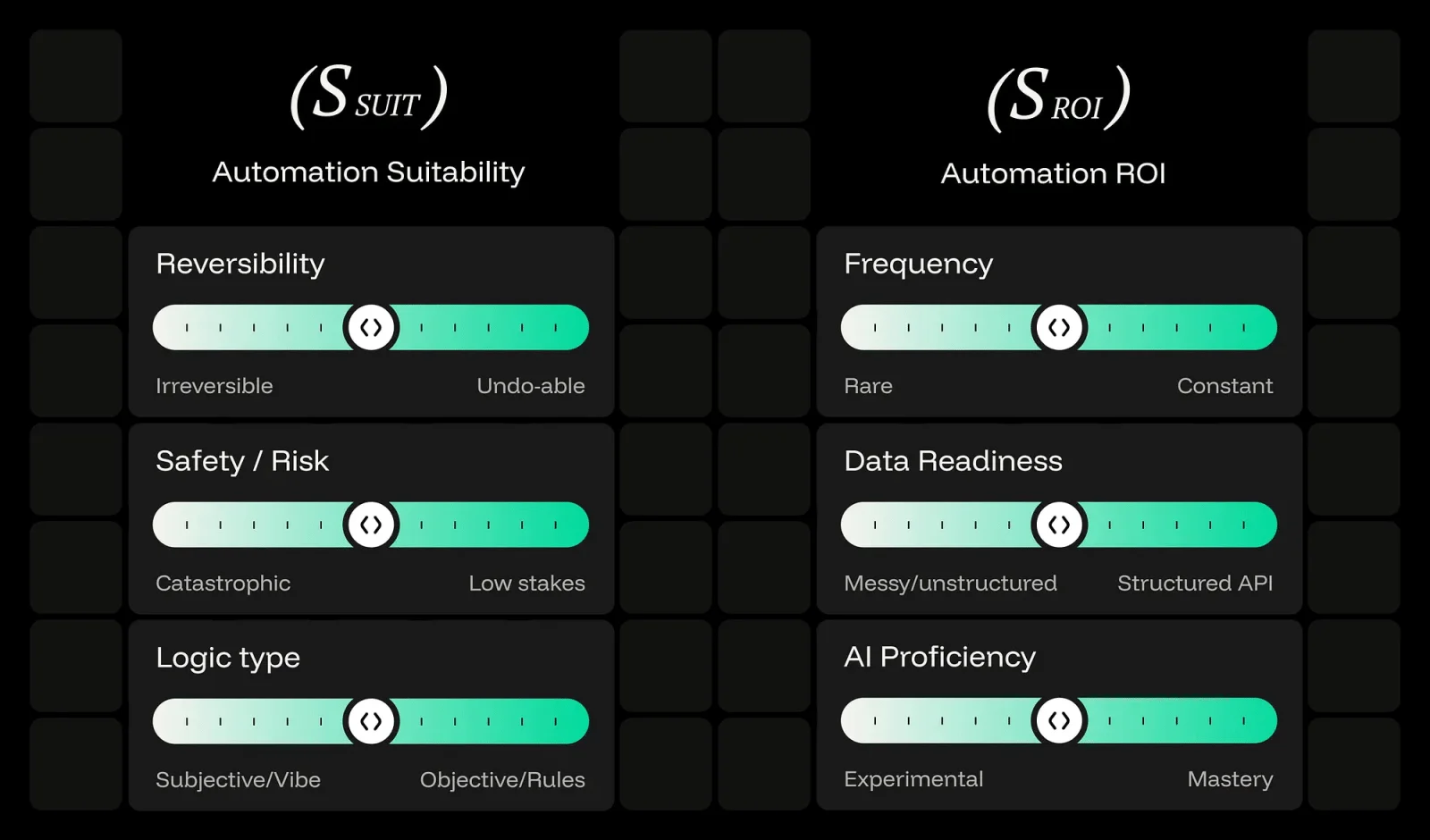

维度 1:自动化适用性 (S_SUIT)

这衡量的是风险和可控性。得分越高,自动化就越安全。

- 可逆性:该操作是否可以撤销?高度可逆性可以支持更深层次的授权。

- 安全/风险:故障的「爆炸半径」是多少?灾难性风险需要人为的防护措施。

- 逻辑类型:该任务是由客观规则(确定性)还是主观「感觉」(概率性)决定的?

维度 2:自动化投资回报率 (S_ROI)

这衡量的是价值和可行性。高分意味着自动化带来的收益丰厚。

- 频率:这是偶尔发生的情况,还是持续的、高容量的工作流程?

- 数据可读性:必要信息是否杂乱无章、结构混乱,还是可以通过结构化的 API 访问?

- AI 能力:当前模型的能力是否展现出足够好的实验结果,或对任务有持续掌握性?

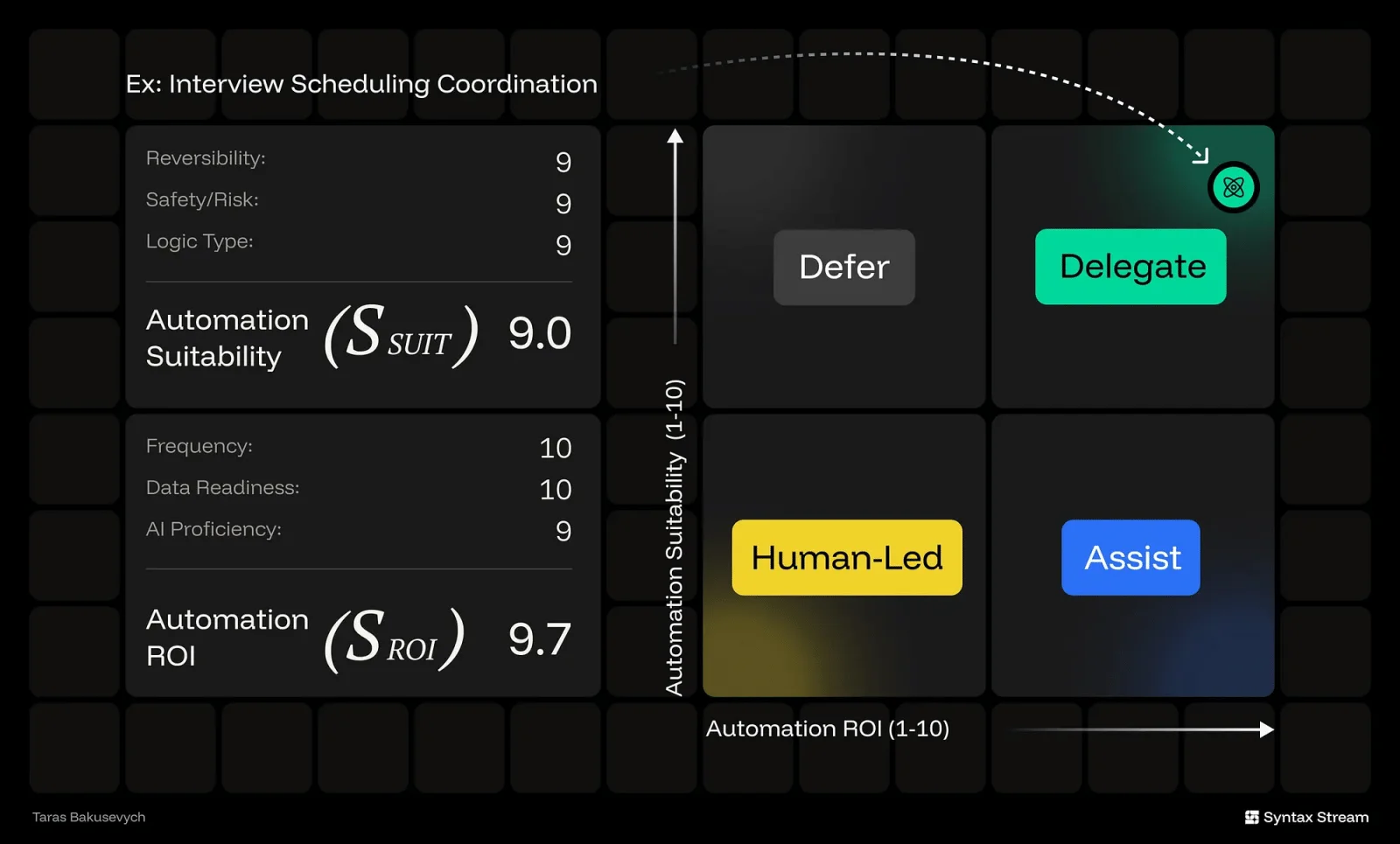

三、将数据映射到控制模式

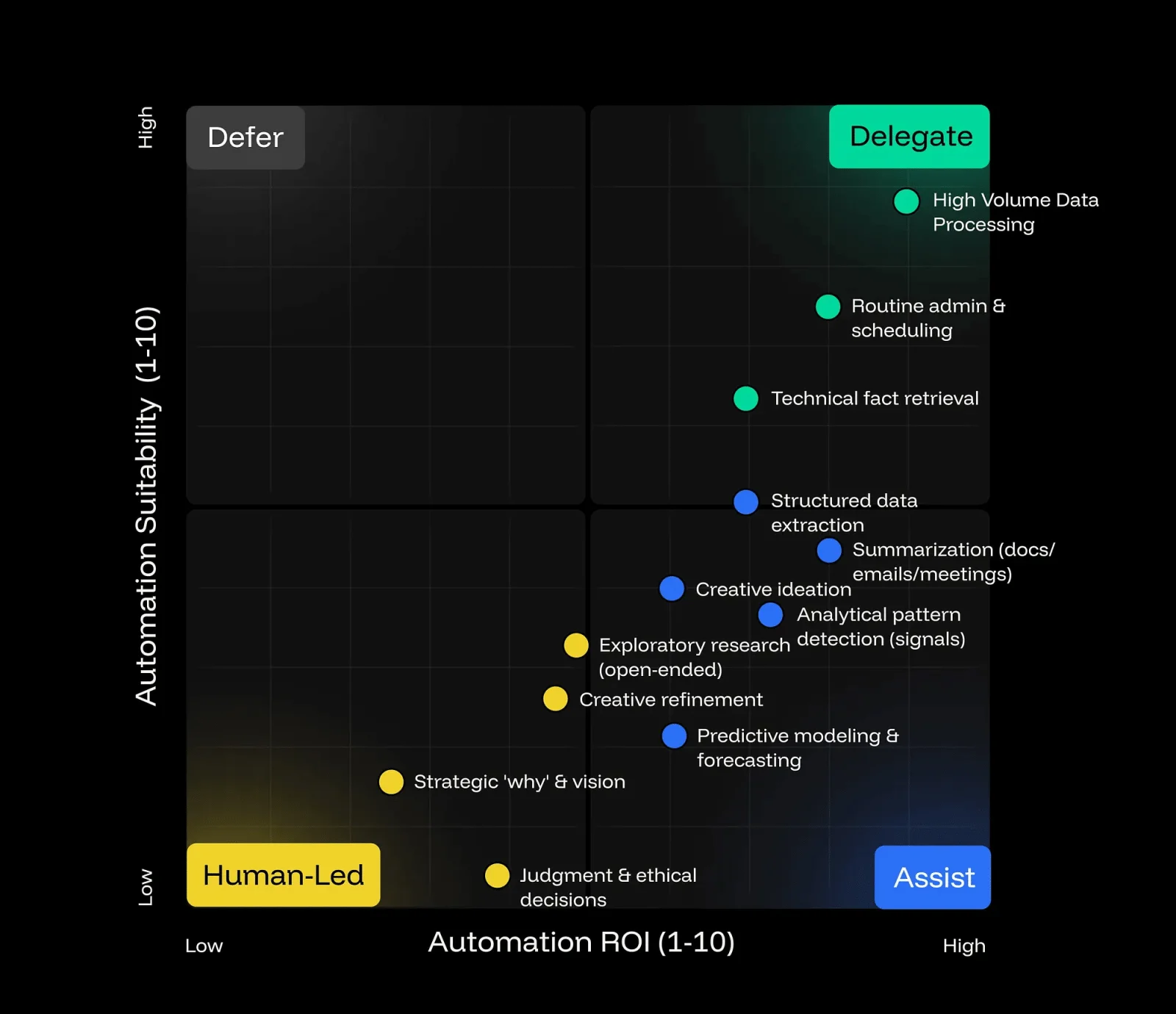

为了从初始获得的评估数据最终落实到具体功能性产品策略,这套框架使用四象限矩阵来确定用户与机器之间的最佳关系。通过将自动化投资回报率 (S_ROI)绘制在 X 轴上,自动化适用性(S_SUIT)绘制在 Y 轴上,你可以将任何工作流程归类到四个不同的战略类别之一。

- 委托模式(高投资回报率/高适用性): AI 在约束条件下执行端到端流程,而人类则转为审核员角色。其目标是通过无形执行和后台防护机制来减少工作量。

- 辅助模式(高投资回报率/低适用性):高杠杆任务,风险过高,不适合完全自主运行。 AI 分步骤进行草稿撰写,需要通过预览进行「人工确认」,并在关键提交时获得明确批准。

- 人为主导(低投资回报率/低适用性):高风险或主观性强的任务,人类判断是主要价值所在。 AI 会根据证据提供建议,但最终的决定权仍然掌握在人手中。

- 推迟操作(低投资回报率/高适用性):自动化操作虽然安全,但投入大于收益。在任务频率或 AI 熟练程度提升投资回报率之前,建议保持手动操作或使用轻量级 AI 辅助工具。

AI 授权矩阵的应用示例:面试安排在适用性和投资回报率方面得分很高,所以这项人物可以成为完全由 AI 授权并辅以人工监督的有力方案。

举个例子:面试安排协调。

这项工作频繁且耗时(投资回报率高),主要基于规则,风险低,而且易于撤销(适用性高)。当我们对其进行评分时,它落在右上象限——委托——这意味着产品应该在限定范围内全程运行,只有在特殊情况下才需要人工介入。

四、速查表

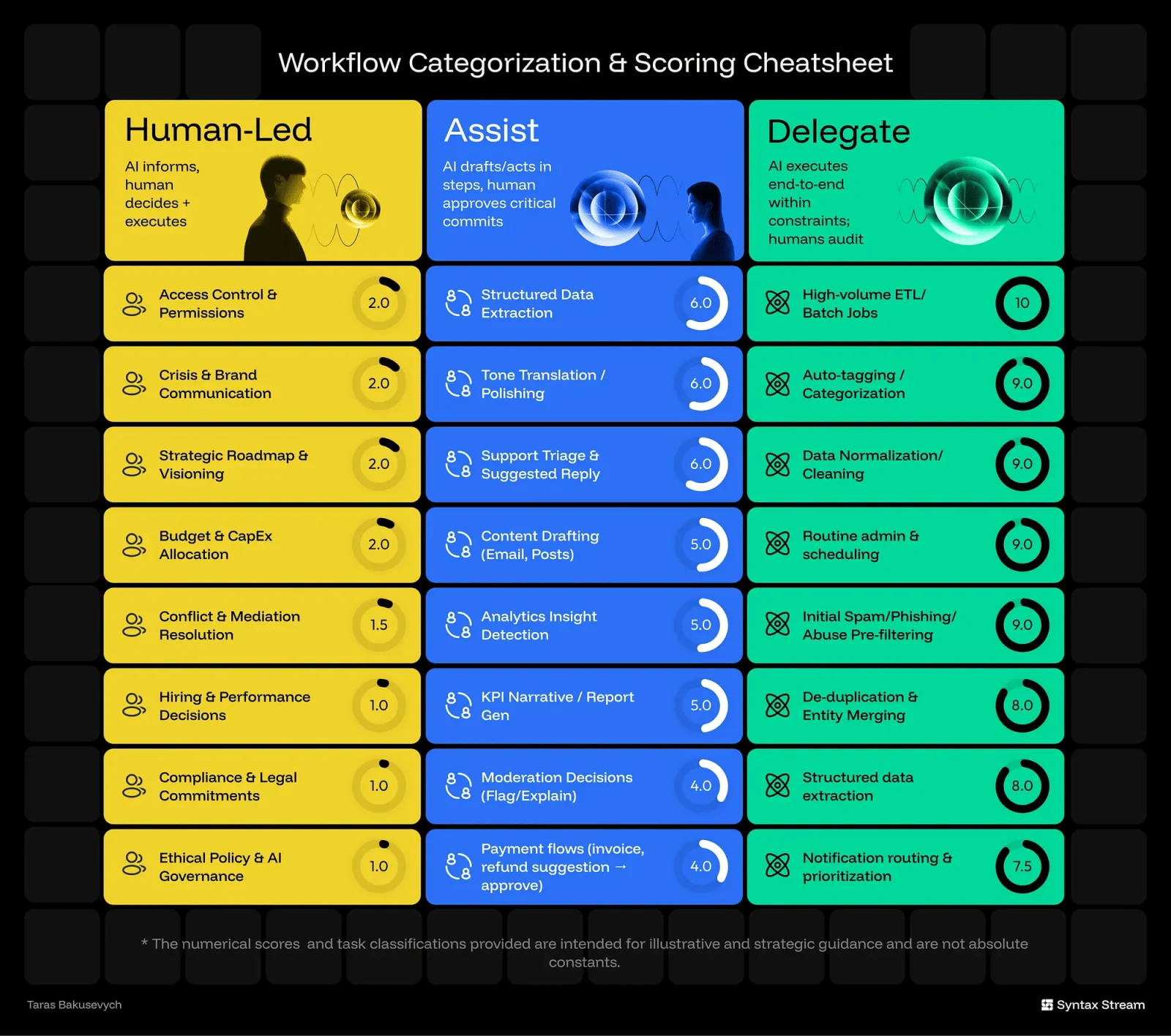

在对数十个工作流程进行评分后,任务的执行方式呈现出清晰的模式:

- (人为主导):任何涉及伦理、法律义务、人事决策、战略方向或危机应对的事项。这些任务需要无法委托给 AI 的人为判断——并非 AI 不具备这种能力,而是因为责任必须由人承担。

- (辅助):内容生成、洞察发现、筛选,以及任何 AI 可以生成高质量初稿但最终仍需人工审核的任务。支付审批和审核决策也属于此类—— AI 提出建议,由人工最终决定。

- (委托 AI):数据操作是此范围的主要内容。包括 ETL 作业、分类、规范化、垃圾邮件过滤、调度和通知路由。数据量大、结构化输入、规则清晰、易于回滚。

对这些人物进行评分的目的并非追求精确,而是为了引发讨论。当你的团队争论「内容审核」应该评为 4 分还是 6 分时,你们就真正开始讨论这项任务究竟需要多大程度的人工监督了。

工作流程分类速查表被展示为三列——人工主导、辅助和委派——以及示例任务以及评分,展现每个工作流程对 AI 自动化的适用程度。

五、6 步应用框架

1. 列出核心工作流程(10-30)。

- 使用动词+宾语:「安排面试」、「批准访问权限」、「处理工单」。

2. 标记确认点。

- 哪些操作真正生效:发送/发布/授权/支付/写入/删除?

3. 使用两个等级(1-10)对每个工作流程进行评分。

- S_SUIT:可逆性 + 风险/影响范围 + 规则与判断;

- S_ROI:频率 + 数据可读性 + AI 性能

4. 在矩阵上绘制图表并分配模式。

- 人工主导、AI 协助处理、委托 AI、延后处理

5. 按模式设计(使用成熟的模式)。

6. 利用这些指标实现自主化的流程。

- 跟踪报错、撤销、异常情况、节省的时间,并审查质量。

这个授权矩阵不会告诉你应该在哪里「添加 AI 」。它会告诉你应该设计哪种形式的控制——自动驾驶、副驾驶、助手或顾问。每项任务都需要对以下问题给出明确的答案:「谁负责掌舵?」

作者:陈子木

想了解更多网站技术的内容,请访问:网站技术